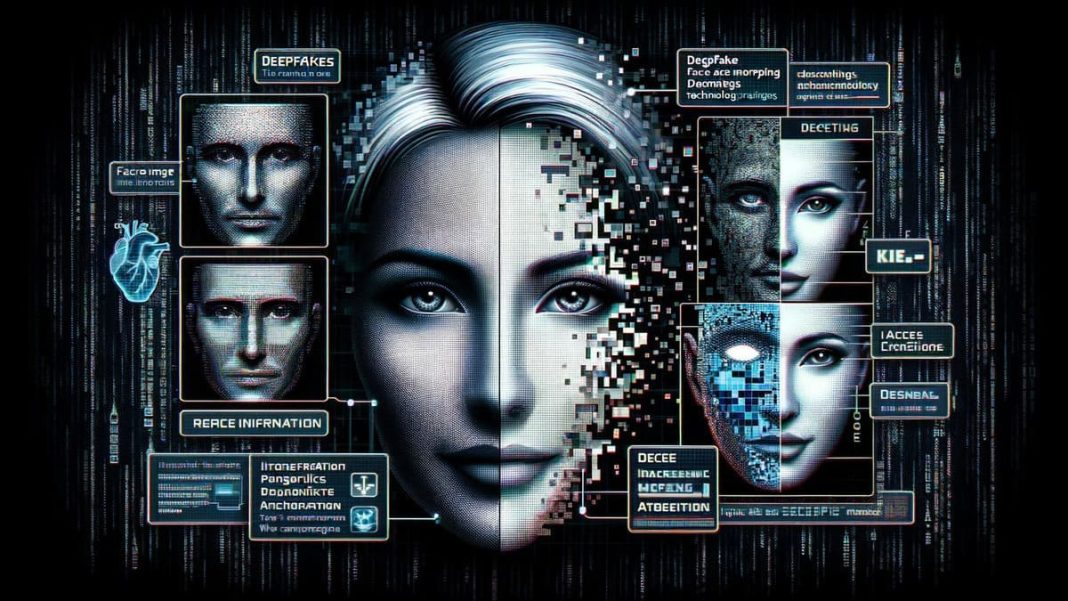

I deepfake, video, immagini o audio manipolati dall’intelligenza artificiale (AI), rappresentano una minaccia per la disinformazione e la sicurezza online.

Il termine “deepfake“ si riferisce a una tecnologia emergente basata sull’intelligenza artificiale (IA) che permette la creazione di video, immagini o audio altamente realistici e convincenti, nei quali le persone sembrano dire o fare cose che non hanno mai realmente detto o fatto. Il nome “deepfake” deriva dalla combinazione delle parole “deep learning“ (apprendimento profondo), una branca dell’IA, e “fake” (falso).

Come funzionano i deepfake

I deepfake sono generati tramite algoritmi di apprendimento profondo chiamati reti neurali. Queste reti sono addestrate su vasti set di dati di immagini reali e suoni per imparare a replicare l’aspetto e il tono di una persona specifica. Una volta che il sistema è sufficientemente addestrato, può generare contenuti falsi convincendo l’osservatore che siano reali.

Perché i deepfake sono pericolosi

- Disinformazione e manipolazione: uno degli usi più pericolosi dei deepfake è la creazione di notizie false o disinformazione. Questi video possono essere utilizzati per manipolare l’opinione pubblica, influenzare le elezioni o causare disordini civili.

- Ricatto e diffamazione: i deepfake possono essere utilizzati per creare materiale compromettente su individui, che può poi essere usato per ricattarli o danneggiare la loro reputazione pubblica.

- Impatto sulla giustizia: i deepfake possono rendere difficile per le autorità distinguere tra prove reali e manipolate, complicando il processo giudiziario e potenzialmente portando a ingiustizie.

- Sicurezza personale: con la crescita dei deepfake, la sicurezza delle persone pubbliche e private diventa sempre più a rischio. Questa tecnologia potrebbe essere usata per creare false prove di crimini o comportamenti inappropriati.

Come riconoscere i deepfake

Nonostante i progressi tecnologici, ci sono ancora alcuni segni che possono aiutare a riconoscere i deepfake:

- Imperfezioni nell’immagine o nel video: guardare per anomalie nelle immagini, come strane increspature sulla pelle, errori di sincronizzazione delle labbra o incoerenze nei movimenti degli occhi.

- Qualità audio: ascoltare attentamente l’audio; spesso nei deepfake, la qualità del suono può sembrare innaturale o non sincronizzata perfettamente con il movimento delle labbra.

- Contesto del contenuto: valutare il contesto del video o dell’immagine. Se sembra improbabile o straordinario, potrebbe essere un segno che il contenuto è stato manipolato.

Mentre i deepfake possono essere utilizzati in modi creativi e innovativi, come nel cinema o nelle pubblicità, i pericoli che presentano sono tanti e importanti. È fondamentale essere consapevoli delle potenziali minacce e lavorare attivamente per sviluppare tecnologie in grado di rilevare e contrapporsi ai deepfake per proteggere l’integrità dell’informazione e la sicurezza personale. La consapevolezza pubblica e la regolamentazione sono essenziali per mitigare gli impatti negativi di questa tecnologia potente ma pericolosa.